比較好奇python對于多進程中copy on write機制的實際使用情況。目前從實驗結果來看,python 使用multiprocessing來創建多進程時,無論數據是否不會被更改,子進程都會復制父進程的狀態(內存空間數據等)。所以如果主進程耗的資源較多時,不小心就會造成不必要的大量的內存復制,從而可能導致內存爆滿的情況。

示例

舉個例子,假設主進程讀取了一個大文件對象的所有行,然后通過multiprocessing創建工作進程,并循環地將每一行數據交給工作進程來處理:

def parse_lines(args): #working ...def main_logic(): f = open(filename , 'r') lines = f.readlines() f.close() pool = multiprocessing.Pool(processes==4) rel = pool.map(parse_lines , itertools.izip(lines , itertools.repeat(second_args)) , int(len(lines)/4)) pool.close() pool.join()

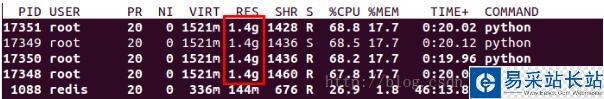

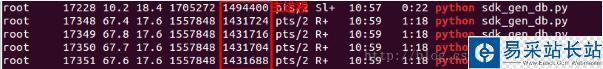

以下是top及ps結果:

(四個子進程)

(父進程及四個子進程)

由上兩張圖可以看出父進程及子進程都各自占用了1.4G左右的內存空間。而大部分內存空間存儲的是讀數據lines,所以這樣的內存開銷太浪費。

優化計劃

1: 在主進程初期未導入大量的py庫之前創建進程,或者動態加載py庫。

2:通過內存共享來減少內存的開銷。

3: 主進程不再讀取文件對象,交給每個工作進程去讀取文件中的相應部分。

改進代碼:

def line_count(file_name): count = -1 #讓空文件的行號顯示0 for count,line in enumerate(open(file_name)): pass #enumerate格式化成了元組,count就是行號,因為從0開始要+1 return count+1def parse_lines(args): f = open(args[0] , 'r') lines = f.readlines()[args[1]:args[2]] #read some lines f.close() #workingdef main_logic(filename,process_num): line_count = line_count(filename) avg_len = int(line_count/process_num) left_cnt = line_count%process_num; pool = multiprocessing.Pool(processes=process_num) for i in xrange(0,process_num): ext_cnt = (i>=process_num-1 and [left_cnt] or [0])[0] st_line = i*avg_len pool.apply_async(parse_lines, ((filename, st_line, st_line+avg_len+ext_cnt),)) #指定進程讀某幾行數據 pool.close() pool.join()

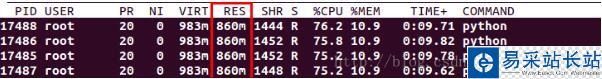

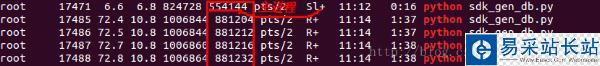

再次用top或者ps來查看進程的內存使用情況:

(四個子進程)

(父進程及四個子進程)

小結

對比兩次的內存使用情況,改進代碼后父進程及子進程所占用的內存明顯減少;所有內存占用相當于原來的一半,這就是減少內存復制的效果。

關于內存使用這方面還有不少優化方法和空間,稍后繼續研究。

新聞熱點

疑難解答