TF-IDF(term frequency–inverse document frequency)是一種用于信息檢索與數據挖掘的常用加權技術。

同樣,理論我這里不再贅述,因為和阮一峰大神早在2013年就將TF-IDF用一種非常通俗的方式講解出來

TF-IDF與余弦相似性的應用(一):自動提取關鍵詞

材料

1.語料庫(已分好詞)

2.停用詞表(哈工大停用詞表)

3.python3.5

語料庫的準備

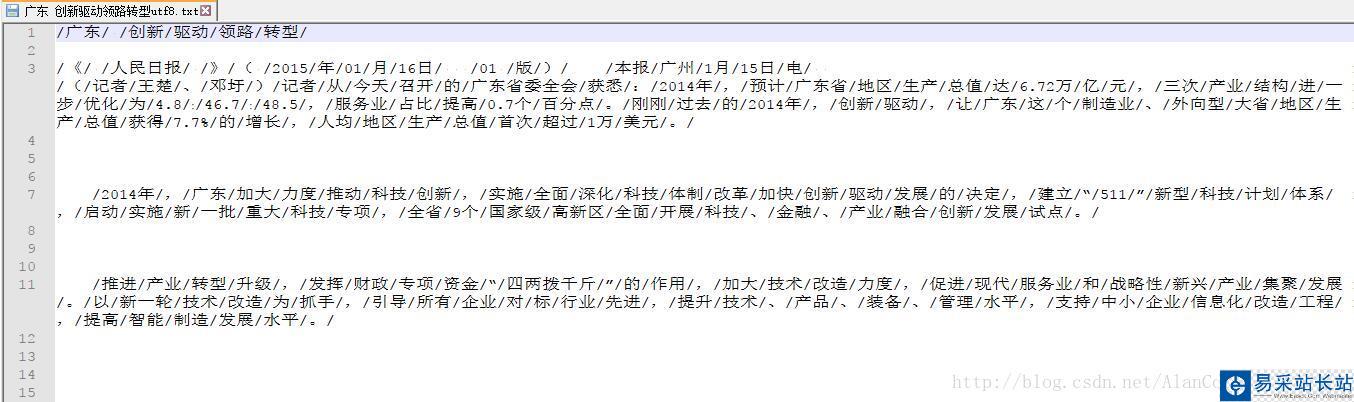

這里使用的語料庫是《人民日報》2015年1月16日至1月18日的發表的新聞。并且在進行TFIDF處理之前已經進行了人工分詞(當然也可以使用jieba分詞,但效果不好)

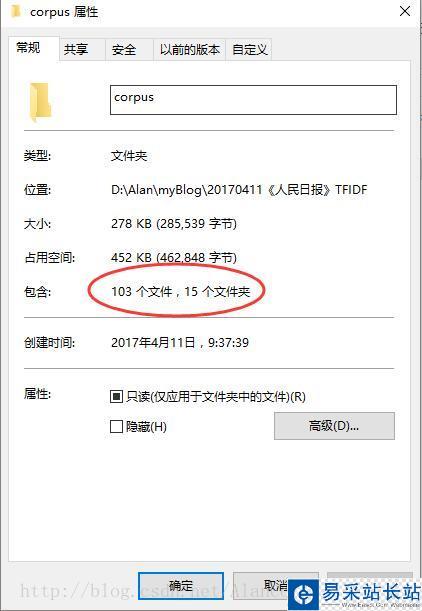

三天的新聞篇章數量如下:

語料庫中共103篇新聞。每篇新聞存入在txt文件中,編碼為UTF-8無BOM

這里放一篇文章示例下:

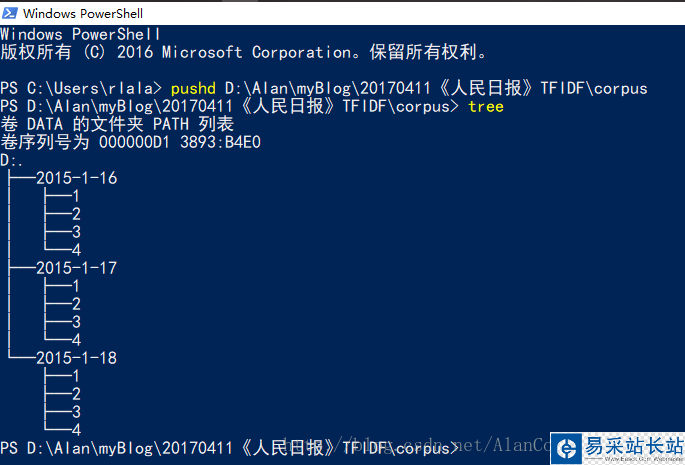

我在自己的項目路徑下新建一個corpus的文件夾,用于存放已經分好詞待計算的語料。corpus文件夾的架構如下:

2015年1月16日至1月18日共三天,每天可獲取的新聞分了四版,因此針對每一天下的每一版我又分別建了編號為1、2、3、4的文件夾,用于存放每一版的新聞。

其實也沒必要這么麻煩,可以直接把所有的新聞都放到一個文件夾下,只是我個人的文件管理習慣。當然放到數據庫里面更好。

關于停用詞表

較好用的停用詞表有哈工大停用詞表、百度停用詞表、川大停用詞表,網上一查一大堆。我這里選擇的是哈工大停用詞表。

代碼實現

# -*- coding: utf-8 -*-# @Date : 2017-04-11 09:31:55# @Author : Alan Lau (rlalan@outlook.com)# @Language : Python3.5import osimport codecsimport mathimport operatordef fun(filepath): # 遍歷文件夾中的所有文件,返回文件list arr = [] for root, dirs, files in os.walk(filepath): for fn in files: arr.append(root+"http://"+fn) return arrdef wry(txt, path): # 寫入txt文件 f = codecs.open(path, 'a', 'utf8') f.write(txt) f.close() return pathdef read(path): # 讀取txt文件,并返回list f = open(path, encoding="utf8") data = [] for line in f.readlines(): data.append(line) return datadef toword(txtlis): # 將一片文章按照‘/'切割成詞表,返回list wordlist = [] alltxt = '' for i in txtlis: alltxt = alltxt+str(i) ridenter = alltxt.replace('/n', '') wordlist = ridenter.split('/') return wordlistdef getstopword(path): # 獲取停用詞表 swlis = [] for i in read(path): outsw = str(i).replace('/n', '') swlis.append(outsw) return swlisdef getridofsw(lis, swlist): # 去除文章中的停用詞 afterswlis = [] for i in lis: if str(i) in swlist: continue else: afterswlis.append(str(i)) return afterswlisdef freqword(wordlis): # 統計詞頻,并返回字典 freword = {} for i in wordlis: if str(i) in freword: count = freword[str(i)] freword[str(i)] = count+1 else: freword[str(i)] = 1 return freworddef corpus(filelist, swlist): # 建立語料庫 alllist = [] for i in filelist: afterswlis = getridofsw(toword(read(str(i))), swlist) alllist.append(afterswlis) return alllistdef wordinfilecount(word, corpuslist): # 查出包含該詞的文檔數 count = 0 # 計數器 for i in corpuslist: for j in i: if word in set(j): # 只要文檔出現該詞,這計數器加1,所以這里用集合 count = count+1 else: continue return countdef tf_idf(wordlis, filelist, corpuslist): # 計算TF-IDF,并返回字典 outdic = {} tf = 0 idf = 0 dic = freqword(wordlis) outlis = [] for i in set(wordlis): tf = dic[str(i)]/len(wordlis) # 計算TF:某個詞在文章中出現的次數/文章總詞數 # 計算IDF:log(語料庫的文檔總數/(包含該詞的文檔數+1)) idf = math.log(len(filelist)/(wordinfilecount(str(i), corpuslist)+1)) tfidf = tf*idf # 計算TF-IDF outdic[str(i)] = tfidf orderdic = sorted(outdic.items(), key=operator.itemgetter( 1), reverse=True) # 給字典排序 return orderdicdef befwry(lis): # 寫入預處理,將list轉為string outall = '' for i in lis: ech = str(i).replace("('", '').replace("',", '/t').replace(')', '') outall = outall+'/t'+ech+'/n' return outalldef main(): swpath = r'D:/Alan/myBlog/20170411《人民日報》TFIDF/code/哈工大停用詞表.txt'#停用詞表路徑 swlist = getstopword(swpath) # 獲取停用詞表列表 filepath = r'D:/Alan/myBlog/20170411《人民日報》TFIDF/corpus' filelist = fun(filepath) # 獲取文件列表 wrypath = r'D:/Alan/myBlog/20170411《人民日報》TFIDF/result/TFIDF.txt' corpuslist = corpus(filelist, swlist) # 建立語料庫 outall = '' for i in filelist: afterswlis = getridofsw(toword(read(str(i))), swlist) # 獲取每一篇已經去除停用的詞表 tfidfdic = tf_idf(afterswlis, filelist, corpuslist) # 計算TF-IDF titleary = str(i).split('//') title = str(titleary[-1]).replace('utf8.txt', '') echout = title+'/n'+befwry(tfidfdic) print(title+' is ok!') outall = outall+echout print(wry(outall, wrypath)+' is ok!')if __name__ == '__main__': main()

新聞熱點

疑難解答