本文實例講述了Python爬蟲框架Scrapy基本用法。分享給大家供大家參考,具體如下:

Xpath

<html><head> <title>標題</title></head><body> <h2>二級標題</h2> <p>爬蟲1</p> <p>爬蟲2</p></body></html>

在上述html代碼中,我要獲取h2的內容,我們可以使用以下代碼進行獲取:

info = response.xpath("/html/body/h2/text()")可以看出/html/body/h2為內容的層次結構,text()則是獲取h2標簽的內容。//p獲取所有p標簽。獲取帶具體屬性的標簽://標簽[@屬性="屬性值"]

<div class="hide"></div>

獲取class為hide的div標簽

div[@class="hide"]

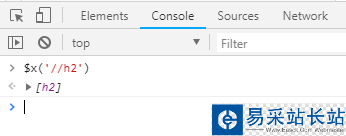

再比如,我們在谷歌Chrome瀏覽器上的Console界面使用$x['//h2']命令獲取頁面中的h2元素信息:

xmlfeed模板

創建一個xmlfeed模板的爬蟲

scrapy genspider -t xmlfeed abc iqianyue.com

核心代碼:

from scrapy.spiders import XMLFeedSpiderclass AbcSpider(XMLFeedSpider): name = 'abc' start_urls = ['http://yum.iqianyue.com/weisuenbook/pyspd/part12/test.xml'] iterator = 'iternodes' # 迭代器,默認為iternodes,是一個基于正則表達式的高性能迭代器。除了iternodes,還有“html”和“xml” itertag = 'person' # 設置從哪個節點(標簽)開始迭代 # parse_node會在節點與提供的標簽名相符時自動調用 def parse_node(self, response, selector): i = {} xpath = "/person/email/text()" info = selector.xpath(xpath).extract() print(info) return icsvfeed模板

創建一個csvfeed模板的爬蟲

scrapy genspider -t csvfeed csvspider iqianyue.com

核心代碼

from scrapy.spiders import CSVFeedSpiderclass CsvspiderSpider(CSVFeedSpider): name = 'csvspider' allowed_domains = ['iqianyue.com'] start_urls = ['http://yum.iqianyue.com/weisuenbook/pyspd/part12/mydata.csv'] # headers 主要存放csv文件中包含的用于提取字段的信息列表 headers = ['name', 'sex', 'addr', 'email'] # delimiter 字段之間的間隔 delimiter = ',' def parse_row(self, response, row): i = {} name = row["name"] sex = row["sex"] addr = row["addr"] email = row["email"] print(name,sex,addr,email) #i['url'] = row['url'] #i['name'] = row['name'] #i['description'] = row['description'] return icrawlfeed模板

創建一個crawlfeed模板的爬蟲

scrapy genspider -t crawlfeed crawlspider sohu.com

核心代碼

class CrawlspiderSpider(CrawlSpider): name = 'crawlspider' allowed_domains = ['sohu.com'] start_urls = ['http://sohu.com/'] rules = ( Rule(LinkExtractor(allow=r'Items/'), callback='parse_item', follow=True), ) def parse_item(self, response): i = {} #i['domain_id'] = response.xpath('//input[@id="sid"]/@value').extract() #i['name'] = response.xpath('//div[@id="name"]').extract() #i['description'] = response.xpath('//div[@id="description"]').extract() return i

|

新聞熱點

疑難解答