自上一篇文章 Z Story : Using Django with GAE Python 后臺抓取多個(gè)網(wǎng)站的頁面全文 后,大體的進(jìn)度如下:

1.增加了Cron: 用來告訴程序每隔30分鐘 讓一個(gè)task 醒來, 跑到指定的那幾個(gè)博客上去爬取最新的更新

2.用google 的 Datastore 來存貯每次爬蟲爬下來的內(nèi)容。。只存貯新的內(nèi)容。。

就像上次說的那樣,這樣以來 性能有了大幅度的提高: 原來的每次請求后, 爬蟲才被喚醒 所以要花大約17秒的時(shí)間才能從后臺輸出到前臺而現(xiàn)在只需要2秒不到

3.對爬蟲進(jìn)行了優(yōu)化

1. Cron.yaml 來安排每個(gè)程序醒來的時(shí)間

經(jīng)過翻文檔, 問問題終于弄明白google的cron的工作原理--實(shí)際上只是google每隔指定的時(shí)間虛擬地訪問一個(gè)我們自己指定的url…

因此在Django 下, 根本不需要寫一個(gè)純的python 程序 一定不要寫:

if __name__=="__main__":

只需要自己配置一個(gè)url 放在views.py里:

def updatePostsDB(request): #deleteAll() SiteInfos=[] SiteInfo={} SiteInfo['PostSite']="L2ZStory" SiteInfo['feedurl']="feed://l2zstory.wordpress.com/feed/" SiteInfo['blog_type']="wordpress" SiteInfos.append(SiteInfo) SiteInfo={} SiteInfo['PostSite']="YukiLife" SiteInfo['feedurl']="feed://blog.sina.com.cn/rss/1583902832.xml" SiteInfo['blog_type']="sina" SiteInfos.append(SiteInfo) SiteInfo={} SiteInfo['PostSite']="ZLife" SiteInfo['feedurl']="feed://ireallife.wordpress.com/feed/" SiteInfo['blog_type']="wordpress" SiteInfos.append(SiteInfo) SiteInfo={} SiteInfo['PostSite']="ZLife_Sina" SiteInfo['feedurl']="feed://blog.sina.com.cn/rss/1650910587.xml" SiteInfo['blog_type']="sina" SiteInfos.append(SiteInfo) try: for site in SiteInfos: feedurl=site['feedurl'] blog_type=site['blog_type'] PostSite=site['PostSite'] PostInfos=getPostInfosFromWeb(feedurl,blog_type) recordToDB(PostSite,PostInfos) Msg="Cron Job Done..." except Exception,e: Msg=str(e) return HttpResponse(Msg) cron.yaml 要放在跟app.yaml同一個(gè)級別上:

cron:

- description: retrieve newest posts

url: /task_updatePosts/

schedule: every 30 minutes

在url.py 里只要指向這個(gè)把task_updatePostsDB 指向url就好了

調(diào)試這個(gè)cron的過程可以用慘烈來形容。。。在stackoverflow上有很多很多人在問為什么自己的cron不能工作。。。我一開始也是滿頭是汗,找不著頭腦。。。最后僥幸弄好了,大體步驟也是空泛的很。。但是很樸實(shí):

首先,一定要確保自己的程序沒有什么syntax error….然后可以自己試著手動訪問一下那個(gè)url 如果cron 正常的話,這個(gè)時(shí)候任務(wù)應(yīng)該已經(jīng)被執(zhí)行了 最后實(shí)在不行的話多看看log…

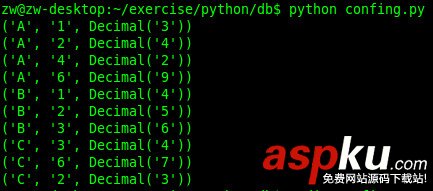

2. Datastore的配置和利用--Using Datastore with Django

我的需求在這里很簡單--沒有join…所以我就直接用了最簡陋的django-helper..

這個(gè)models.py 是個(gè)重點(diǎn):

from appengine_django.models import BaseModel

from google.appengine.ext import db

classPostsDB(BaseModel):

link=db.LinkProperty()

style="margin: 0px; padding: 0px; line-height: 25.2px; width: 660px; overflow: hidden; clear: both;">

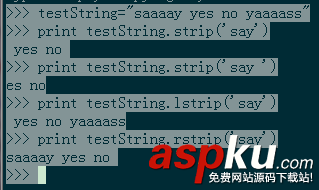

import urllib#from BeautifulSoup import BeautifulSoupfrom pyquery import PyQuery as pqdef getArticleList(url): lstArticles=[] url_prefix=url[:-6] Cnt=1 response=urllib.urlopen(url) html=response.read() d=pq(html) try: pageCnt=d("ul.SG_pages").find('span') pageCnt=int(d(pageCnt).text()[1:-1]) except: pageCnt=1 for i in range(1,pageCnt+1): url=url_prefix+str(i)+".html" #print url response=urllib.urlopen(url) html=response.read() d=pq(html) title_spans=d(".atc_title").find('a') date_spans=d('.atc_tm') for j in range(0,len(title_spans)): titleObj=title_spans[j] dateObj=date_spans[j] article={} article['link']= d(titleObj).attr('href') article['title']= d(titleObj).text() article['date']=d(dateObj).text() article['desc']=getPageContent(article['link']) lstArticles.append(article) return lstArticles def getPageContent(url): #get Page Content response=urllib.urlopen(url) html=response.read() d=pq(html) pageContent=d("div.articalContent").text() #print pageContent return pageContentdef main(): url='http://blog.sina.com.cn/s/articlelist_1191258123_0_1.html'#Han Han url="http://blog.sina.com.cn/s/articlelist_1225833283_0_1.html"#Gu Du Chuan Ling url="http://blog.sina.com.cn/s/articlelist_1650910587_0_1.html"#Feng url="http://blog.sina.com.cn/s/articlelist_1583902832_0_1.html"#Yuki lstArticles=getArticleList(url) for article in lstArticles: f=open("blogs/"+article['date']+"_"+article['title']+".txt",'w') f.write(article['desc'].encode('utf-8')) #特別注意對中文的處理 f.close() #print article['desc'] if __name__=='__main__': main() 對PyQuery的推薦。。

很遺憾的說, BueautifulSoup讓我深深的失望了。。。在我寫上篇文章的時(shí)候,當(dāng)時(shí)有個(gè)小bug..一直找不到原因。。在我回家后,又搭上了很多時(shí)間試圖去弄明白為什么BueautifulSoup一直不能抓到我想要的內(nèi)容。。。后來大體看了看它selector部分的源代碼覺得應(yīng)該是它對于很多還有<script>tag的不規(guī)范html頁面的解析不準(zhǔn)確。。。

我放棄了這個(gè)庫, 又試了lxml..基于xpath 很好用。。但是xpath的東西我老是需要查文檔。。。所以我又找了個(gè)庫PyQuery…可以用jQuery選擇器的工具。。。非常非常非常好用。。。。具體的用法就看上面吧。。。這個(gè)庫有前途。。。

隱憂

因?yàn)閜yquery基于lxml…而lxml的底層又是c…所以估計(jì)在gae上用不了。。。我這個(gè)爬蟲只能現(xiàn)在在我的電腦上爬好東西。。。然后push到server上。。。

總結(jié)

一句話, 我愛死Python了

兩句話, 我愛死Python了,我愛死Django了

三句話, 我愛死Python了,我愛死Django了,我愛死jQuery了。。。

四句號, 我愛死Python了,我愛死Django了,我愛死jQuery了,我愛死pyQuery了。。。